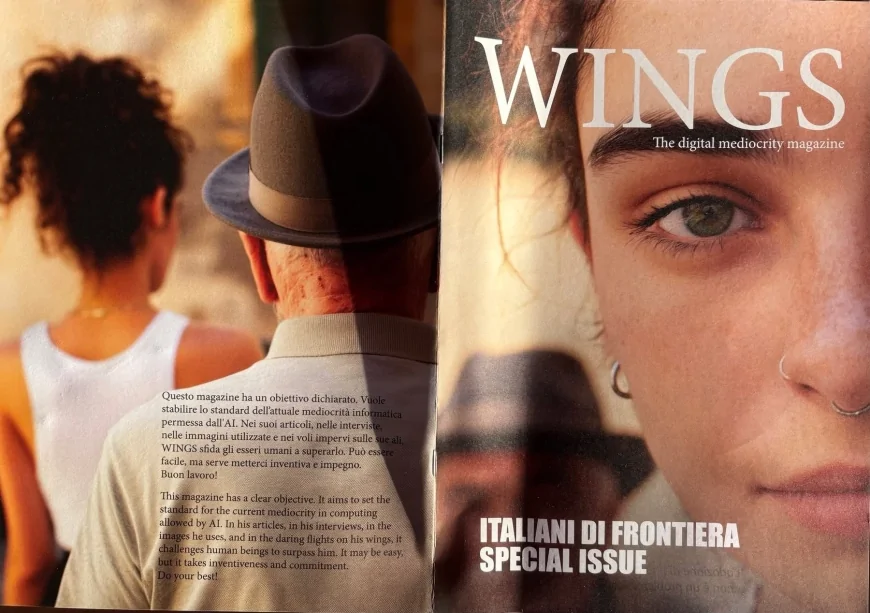

Giornalismo artificiale, significati umani. La rivista “Wings” di Sharazad inaugura una redazione di agenti AI dedicando un numero agli “Italiani di Frontiera” di Roberto Bonzio

L’esperimento di una redazione virtuale riapre il dibattito su competenze, responsabilità e senso del racconto nell’ecosistema dell’informazione

Un laboratorio narrativo tra umanità e algoritmi

Cosa accade quando le storie di talenti italiani passano attraverso una redazione di giornalisti generati dall'intelligenza artificiale? “Wings”, edizione speciale della rivista di Sharazad, agenzia di consulenza fondata da Stefano Schiavo, offre una prima risposta concreta: è possibile combinare strumenti diversi senza rinunciare alla qualità del racconto.

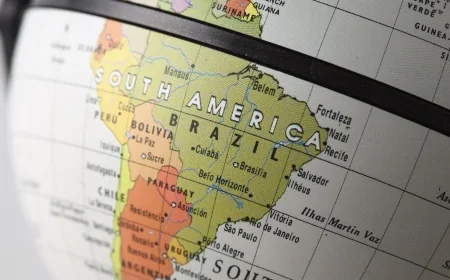

Il numero è dedicato agli Italiani di Frontiera di Roberto Bonzio, un progetto che da oltre quindici anni documenta percorsi professionali e umani fuori dagli schemi. Bonzio ha lasciato la scrivania dell’agenzia Reuters per concentrarsi su storie di cittadini italiani che hanno scelto strade non tradizionali, in contesti che spaziano dalla Silicon Valley ai laboratori di ricerca, dalle periferie urbane a realtà culturali indipendenti. Questa lunga attività di raccolta e interpretazione ha prodotto un patrimonio narrativo che valorizzare singole eccellenze e permette di osservare come creatività, competenze e capacità di adattamento costituiscano un tratto distintivo dell’esperienza italiana nel mondo.

La redazione di agenti AI di Wings utilizza un “motore delle interviste” che permette di condurre indagini su più livelli, soprattutto economici, trasformando dati e conversazioni reali in insight narrativi. La tecnologia di Tacita.ai rende possibile ricerche di mercato, white paper, analisi statistiche e indagini realizzate attraverso interviste autentiche a persone reali, ma condotte da intervistatori artificiali progettati ad hoc.

In Wings, questa sinergia ha generato articoli che portano dentro di sé una doppia anima: la creatività umana e l’efficienza dell’intelligenza artificiale. Un ampliamento delle possibilità del racconto e una nuova forma di giornalismo ibrido che moltiplica l'esperienza umana.

A Milano una conversazione sul futuro del giornalismo

L’arrivo di giornalisti artificiali, agenti AI capaci di condurre interviste, analizzare dati e strutturare testi è un esperimento che interroga il giornalismo alla sua radice L’esperienza presentata durante l’incontro “Giornalismo artificiale” organizzato a Milano il 12 novembre da Divergens, ha reso evidente che siamo di fronte a un cambiamento di contesto.

Sul palco, il registro ironico di Germano Lanzoni ha ricordato un punto essenziale: ogni trasformazione genera paure, e la comicità può aiutare a osservarle da un’angolatura meno rigida. Ridere dell’ignoto crea spazi per discuterne. Allo stesso modo, gli interventi di esperti di organizzazioni e futuro del lavoro hanno mostrato come l’AI stia trasformando le professioni tecniche, e le relazioni umane.

Una mappatura in evoluzione: dai primi studi alle applicazioni contemporanee dell’AI nel giornalismo

La discussione si inserisce nel solco aperto dal professor Charlie Beckett della London School of Economics, che con il progetto JournalismAI ha posto le basi per un dibattito globale sulle trasformazioni introdotte dall’intelligenza artificiale nelle redazioni. Beckett ha avviato una delle prime esplorazioni sistematiche sul rapporto tra intelligenza artificiale e pratiche giornalistiche, nel rapporto del 2019 aveva coinvolto 71 organizzazioni in 32 Paesi e poneva l’accento sulle prime aree in cui l’intelligenza artificiale stava penetrando nei processi giornalistici: raccolta dei dati, automazione di flussi di lavoro, archiviazione e personalizzazione. Successivamente, una nuova indagine del 2023 ha ampliato il campione a 105 redazioni operanti in 46 Paesi, segnando un passaggio quantitativo e qualitativo: l’adozione delle tecnologie di generative AI ha raggiunto circa l’85% dei casi, ma allo stesso tempo mette in rilievo la necessità di sviluppare nuove competenze, ridefinire ruoli e gestire criticamente i rischi legati a bias, etica e diversità linguistica.

Cosa può fare e cosa non può fare un giornalista artificiale

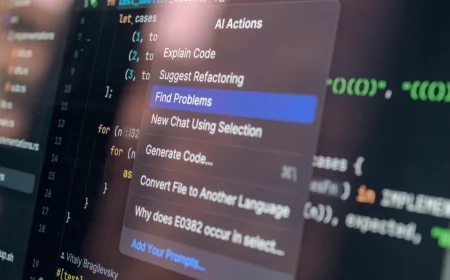

Quando si parla di giornalisti artificiali, la tentazione è immaginare una sostituzione totale del lavoro umano. In realtà, ciò che l’intelligenza artificiale rende possibile è soprattutto un diverso equilibrio tra le fasi della produzione editoriale. Gli agenti AI sono particolarmente efficaci nel gestire compiti che richiedono rigore, costanza e velocità: possono analizzare grandi quantità di dati, organizzare materiali eterogenei, riconoscere ricorrenze e anomalie, formulare serie di domande con coerenza e mantenere una struttura stabile nelle interviste. In questi ambiti la loro presenza può aumentare l’efficienza, ridurre gli errori meccanici e permettere alle redazioni di affrontare indagini complesse con una maggiore rapidità.

Questa capacità operativa, tuttavia, non coincide con ciò che chiamiamo comprensione. Un algoritmo non interpreta ciò che raccoglie, non attribuisce significati profondi a una risposta né coglie le sfumature emotive che emergono in un dialogo autentico. Può registrare un’esitazione, ma non comprenderne la ragione; può proporre una sintesi, ma non decidere se sia la sintesi più giusta o rispettosa per chi è coinvolto. La responsabilità narrativa, così come quella etica, rimane una competenza umana, perché richiede sensibilità, esperienza e un’attenzione al contesto che nessun modello statistico può replicare.

Ciò che l’AI non può sostituire è anche la relazione. Molte storie nascono da un clima di fiducia, da un ascolto che si costruisce lentamente, da uno scambio in cui l’intervistato sente di potersi affidare all’intervistatore. Un agente artificiale può facilitare la raccolta delle informazioni, ma non instaurare questo tipo di legame. Allo stesso modo non può sviluppare un punto di vista originale: rielabora ciò che ha già visto altrove e lo restituisce in forme più o meno raffinate, ma non apre sentieri nuovi.

Per questo parlare di “giornalisti artificiali” significa ragionare su una collaborazione tra l’AI che aiuta a preparare il terreno e l’essere umano che ne costruisce il significatoÈ nell’incontro tra queste due dimensioni che possono nascere nuove forme di indagine e nuovi modi di raccontare, senza rinunciare a ciò che rende il giornalismo un’attività profondamente umana.

Le implicazioni deontologiche del giornalismo algoritmico

L’ingresso dell’intelligenza artificiale nelle redazioni modifica il modo in cui le notizie prendono forma e impone una riflessione attenta sugli equilibri che regolano il lavoro giornalistico. La prima responsabilità riguarda la trasparenza: quando un contenuto è stato generato o supportato da agenti artificiali, è essenziale comunicarlo al lettore. Non per sollevare preoccupazioni, ma per rispettare il principio di chiarezza che da sempre accompagna il giornalismo di qualità.

C’è poi la questione, più profonda, della responsabilità editoriale. Un algoritmo non può rispondere delle scelte che compie, né delle conseguenze che queste possono avere sulle persone e sui contesti. Per questo ogni fase del lavoro, dalla selezione delle informazioni alla loro interpretazione, continua a richiedere una supervisione umana attenta, capace di verificare la correttezza dei fatti, di contestualizzare i dati e di valutare quali implicazioni possa generare un’informazione resa pubblica.

L’uso di sistemi algoritmici porta con sé anche il tema dei bias. I modelli di AI apprendono da grandi masse di dati e, insieme ai contenuti, possono assorbire schemi culturali, preferenze e distorsioni presenti nei materiali utilizzati per addestrarli. Le domande poste da un agente virtuale, le storie che seleziona, le priorità che attribuisce ai temi non sono mai completamente neutrali. Per questo è necessario mantenere uno sguardo critico sul modo in cui l’AI orienta il processo narrativo, intervenendo quando è necessario per riequilibrare la prospettiva.

Un’altra attenzione riguarda il rapporto con le persone intervistate. L’interlocutore ha diritto di sapere se sta parlando con un essere umano o con un agente costruito digitalmente, e in che modo verranno utilizzate le informazioni condivise. È un punto che tocca non solo la privacy, ma anche la fiducia, elemento centrale in qualunque forma di narrazione basata sull’ascolto.

Infine, c’è un rischio più sottile: l’omologazione. L’AI tende a riprodurre forme note, strutture consolidate, linguaggi prevalenti. Se non accompagnata da una forte presenza umana, la produzione dei contenuti potrebbe progressivamente appiattirsi verso stili riconoscibili e prevedibili, riducendo quella varietà di sguardi che costituisce una delle ricchezze del giornalismo.

Questi aspetti rappresentano coordinate fondamentali per integrare l’intelligenza artificiale nei principi etici della professione e reinterpretarli alla luce di strumenti nuovi.

Qual è la tua reazione?

Mi piace

0

Mi piace

0

Antipatia

0

Antipatia

0

Amore

0

Amore

0

Divertente

0

Divertente

0

Arrabbiato

0

Arrabbiato

0

Triste

0

Triste

0

Oh

0

Oh

0